导语 近日,一项来自 Sakana AI 的研究突破了当前大模型竞争的格局。 他们提出了一种名为 Multi-LLM AB-MCTS 的新算法,首次实现了让 OpenAI、谷歌和 DeepSeek 的顶尖模型在推理时协同工作,组建成一支“AI梦之队”。 这个“三模合一”的集体智能在极具挑战性的基准测试中,展现出远超任何单一模型的能力,将解题成功率提升了超过30%。

AI“梦之队”的诞生

长期以来,人工智能领域的竞争主要围绕着单个模型的性能展开,各大科技巨头都在努力打造更强大的“单体”AI。 然而,Sakana AI 的研究提供了一个全新的思路:与其追求单一的“最强王者”,不如将不同模型的独特优势结合起来,形成“群体智慧”。

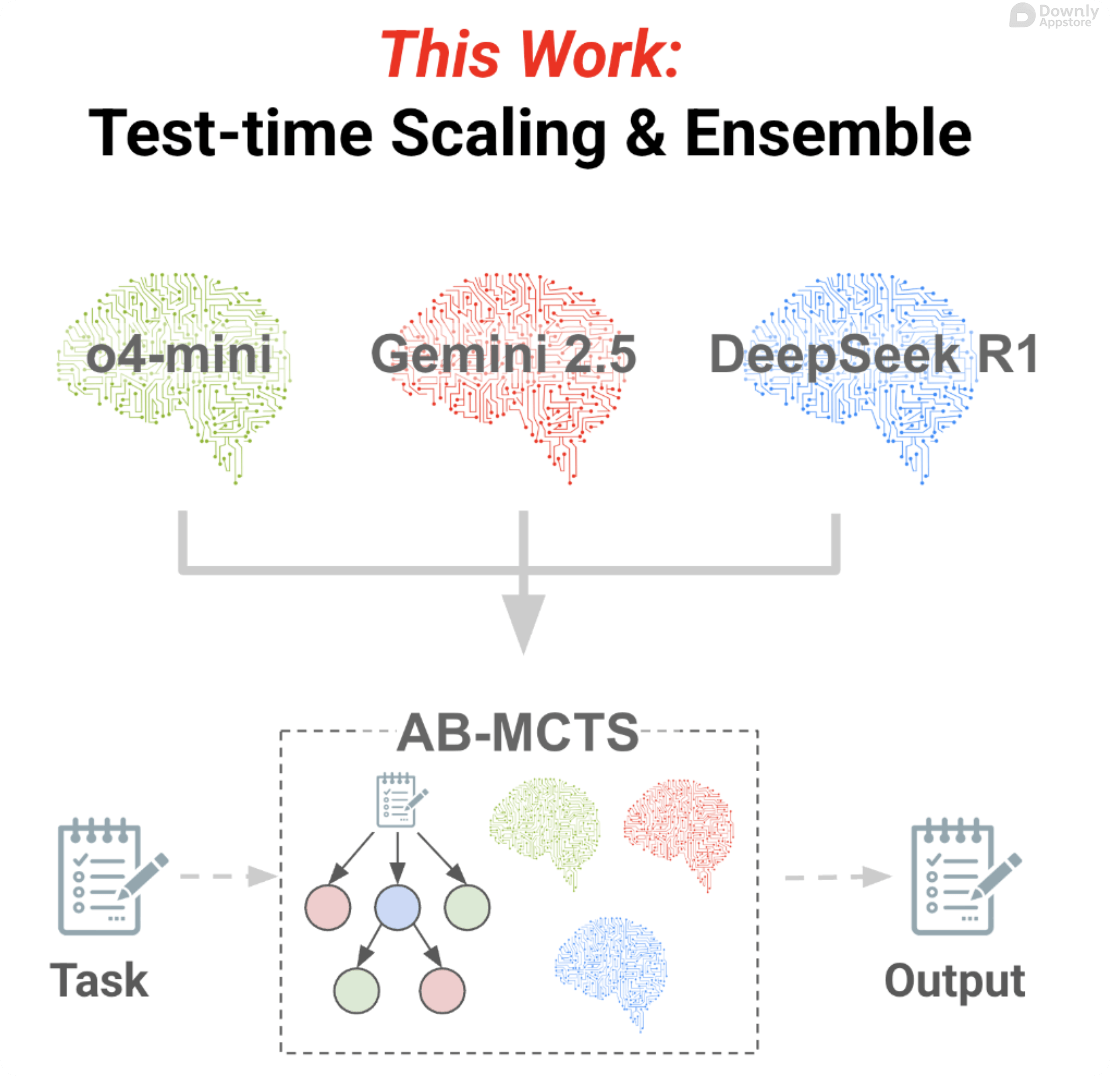

这项研究并非一次企业级的合作,而是一次技术层面的创举。 研究人员利用他们开发的 Multi-LLM AB-MCTS 框架,将三个来自不同公司的前沿模型——o4-mini、Gemini-2.5-Pro 和 DeepSeek-R1-0528——有效地整合在一起。 这个系统能够在解决复杂问题时,像一个团队一样,动态地调用最适合当前任务的模型来执行特定步骤。

这项研究并非一次企业级的合作,而是一次技术层面的创举。 研究人员利用他们开发的 Multi-LLM AB-MCTS 框架,将三个来自不同公司的前沿模型——o4-mini、Gemini-2.5-Pro 和 DeepSeek-R1-0528——有效地整合在一起。 这个系统能够在解决复杂问题时,像一个团队一样,动态地调用最适合当前任务的模型来执行特定步骤。

解密核心技术 AB-MCTS

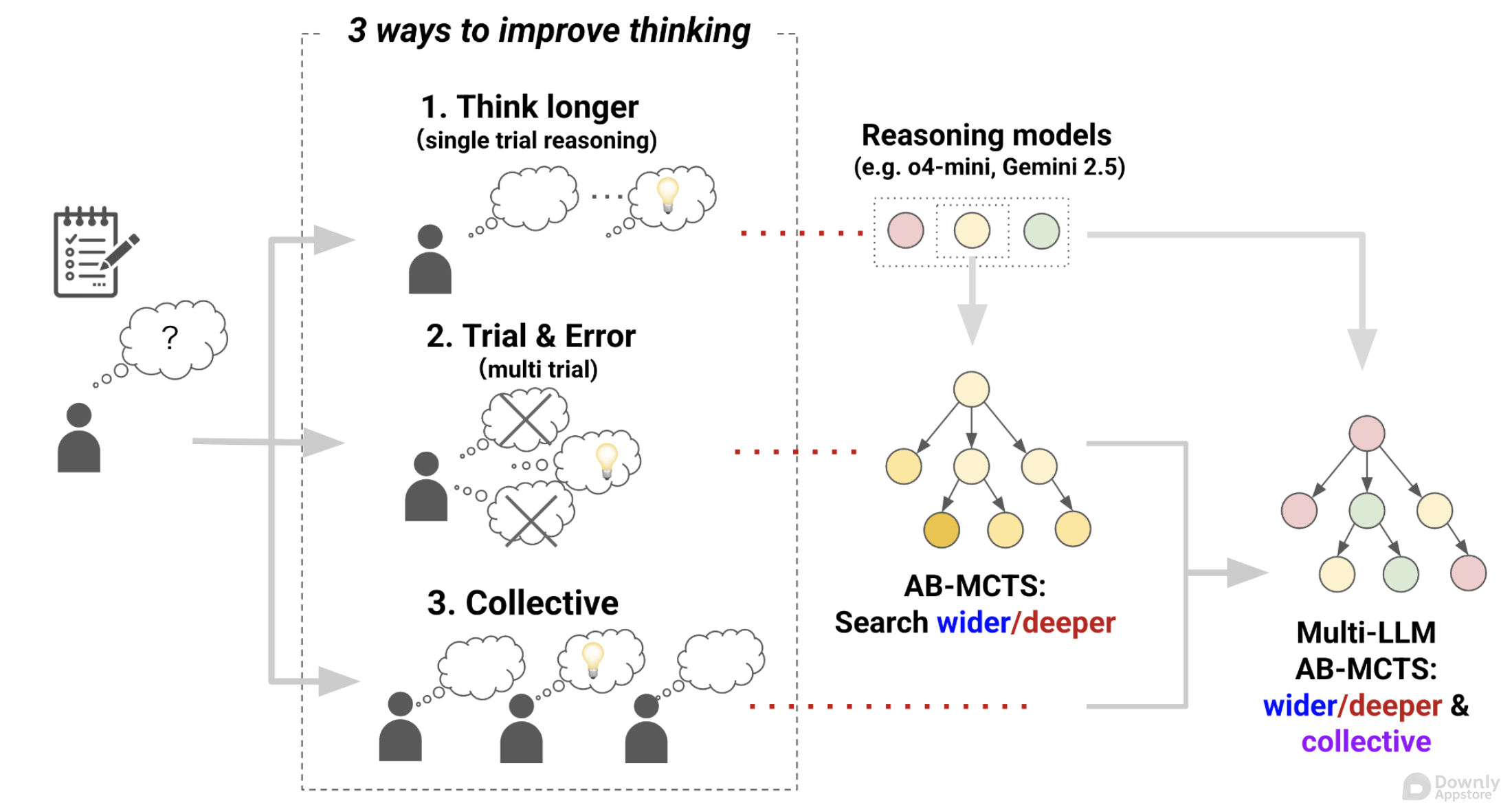

这项突破的核心是一种名为“自适应分支蒙特卡洛树搜索”(AB-MCTS)的算法,它属于“推理时扩展”(Inference-Time Scaling)技术的一种。 简单来说,就是让AI在面对难题时,通过投入更多的计算资源进行“深度思考”和“反复试错”,而不是只给一次机会。

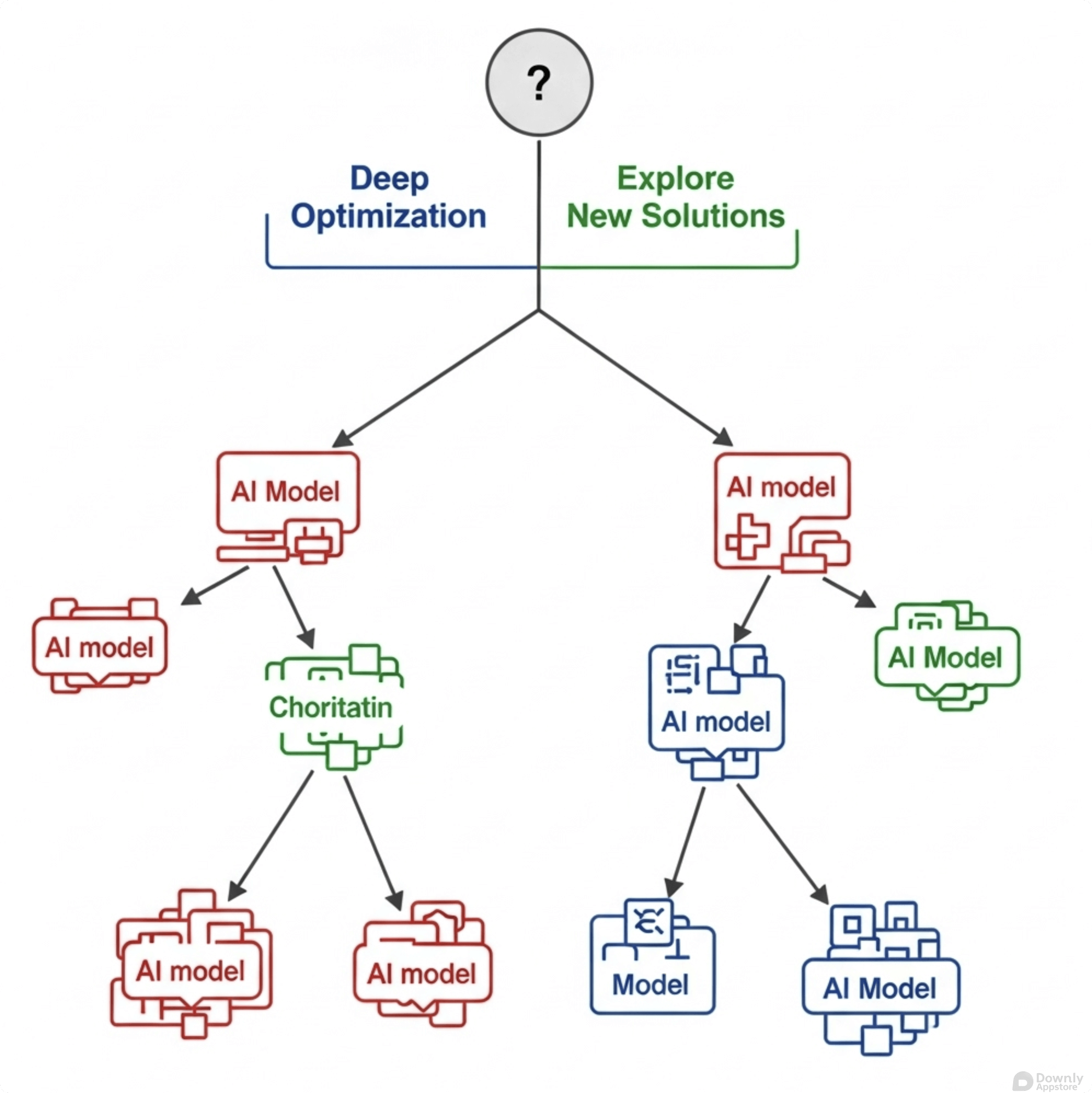

过往的方法通常要么是“深度优先”,即对一个想法不断优化;要么是“广度优先”,即产生许多个全新的想法。 这两种方式各有局限。 而 AB-MCTS 算法巧妙地扩展了AlphaGo所使用的蒙特卡洛树搜索技术,能够在“深入优化一个方案”和“探索全新可能性”之间取得动态平衡。

过往的方法通常要么是“深度优先”,即对一个想法不断优化;要么是“广度优先”,即产生许多个全新的想法。 这两种方式各有局限。 而 AB-MCTS 算法巧妙地扩展了AlphaGo所使用的蒙特卡洛树搜索技术,能够在“深入优化一个方案”和“探索全新可能性”之间取得动态平衡。

在此基础上,Multi-LLM AB-MCTS 增加了第三个维度:AI选择。 在每一步决策时,算法不仅要决定是“走深”还是“走宽”,还要决定该任务由哪个模型来执行最有效,从而实现真正的优势互补。

1+1+1 > 3 惊人的实验结果

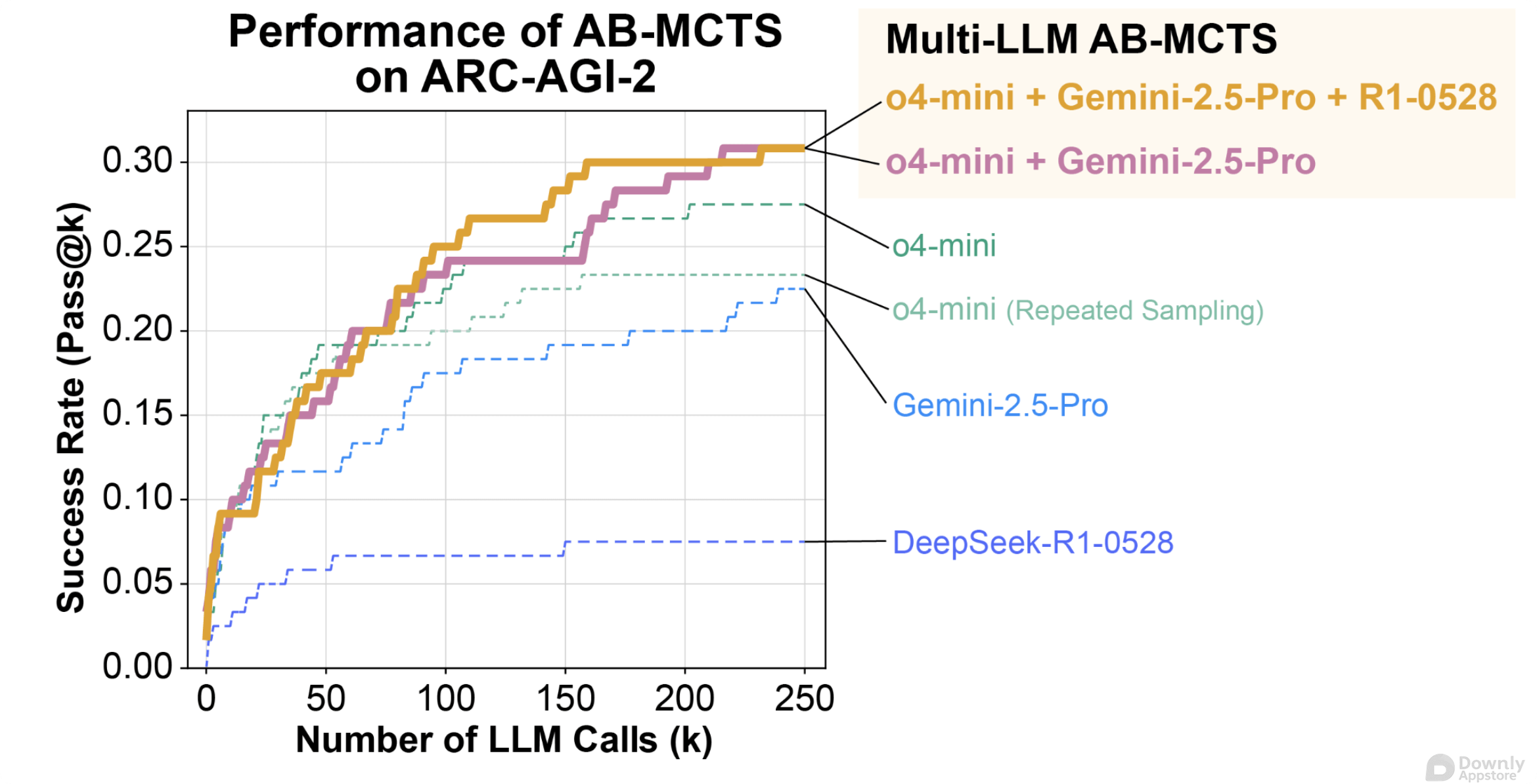

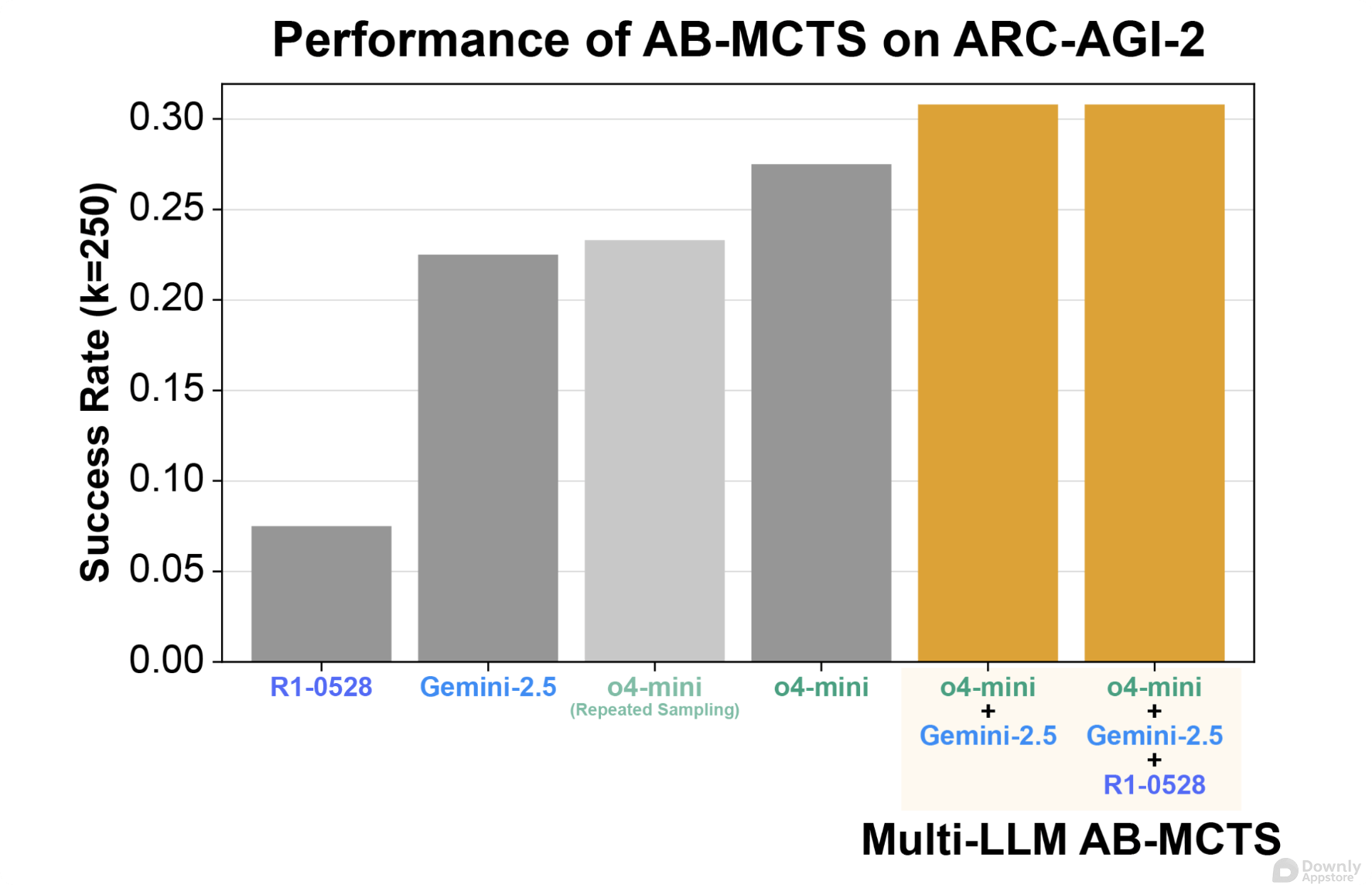

为了验证“AI梦之队”的真实战力,研究团队在极具挑战性的 ARC-AGI-2 基准测试上进行了实验。 结果令人瞩目:

通过让三个模型协同工作,Multi-LLM AB-MCTS 最终解决了超过 30% 的问题。 相比之下,作为性能最强的单一模型之一,o4-mini 即便使用了新的 AB-MCTS 算法,成功率也只有 27.5%,而使用传统的重复采样方法更是只有 23%。 这证明了群体智慧的巨大优势。

通过让三个模型协同工作,Multi-LLM AB-MCTS 最终解决了超过 30% 的问题。 相比之下,作为性能最强的单一模型之一,o4-mini 即便使用了新的 AB-MCTS 算法,成功率也只有 27.5%,而使用传统的重复采样方法更是只有 23%。 这证明了群体智慧的巨大优势。

更有趣的发现是,协作的价值并非简单地让最强的模型去解决问题。 实验中,一些单个模型表现不佳的案例,却在多模型协作中迎刃而解。 比如,o4-mini 先生成一个不完全正确的初步答案,而 DeepSeek-R1-0528 能够在这个错误答案的启发下,接力修正并最终得出正确解法。 这充分展示了不同模型间思维碰撞产生的火花。

未来展望 群体智能的黎明

Sakana AI 的这项研究标志着AI发展的一个重要转向,即从追求“模型规模”转向探索“模型使用”的智慧。 它证明了通过智能算法将现有顶尖模型的能力进行组合,可以有效突破单一模型的性能瓶颈。

正如人类历史上众多伟大的成就都源于协作而非个人英雄主义,AI的未来或许也并非由一个无所不能的“超级AI”主宰,而是由无数个各具特长的AI组成的、高效协作的“集体智能”来开创。 为了推动这一领域的发展,Sakana AI 已经将该算法框架以“TreeQuest”之名开源,供全球的研究者使用和探索。

相关推荐

2025 AI 技术峰会

AI 实战课程

热门工具

AI 助手

智能对话,提升效率

智能图像处理

一键美化,智能修图

AI 翻译

多语言实时翻译

评论 (0)

暂无评论,快来发表第一条评论吧!