导语 9月17日凌晨,阿里巴巴震撼开源其首个深度研究AI智能体——通义DeepResearch。 这一模型在多项权威Agent评测中,凭借仅3B的激活参数规模,性能全面超越基于OpenAI o3、DeepSeek V3.1等业界顶尖模型的Agent,登顶开源Agent模型榜首。 目前,该模型的代码、框架和方案均已在多个开源社区上线。

9月17日凌晨,阿里巴巴宣布正式开源其首个深度研究Agent模型——通义DeepResearch。 这标志着阿里在AI智能体领域的开源布局再度加码。今年以来,阿里已相继开源了WebWalker、WebDancer和WebSailor等多款在检索和推理方面取得SOTA(State-of-the-art)成绩的智能体,而通义DeepResearch的加入,无疑为这一布局增添了浓墨重彩的一笔。

性能卓越 登顶开源榜首

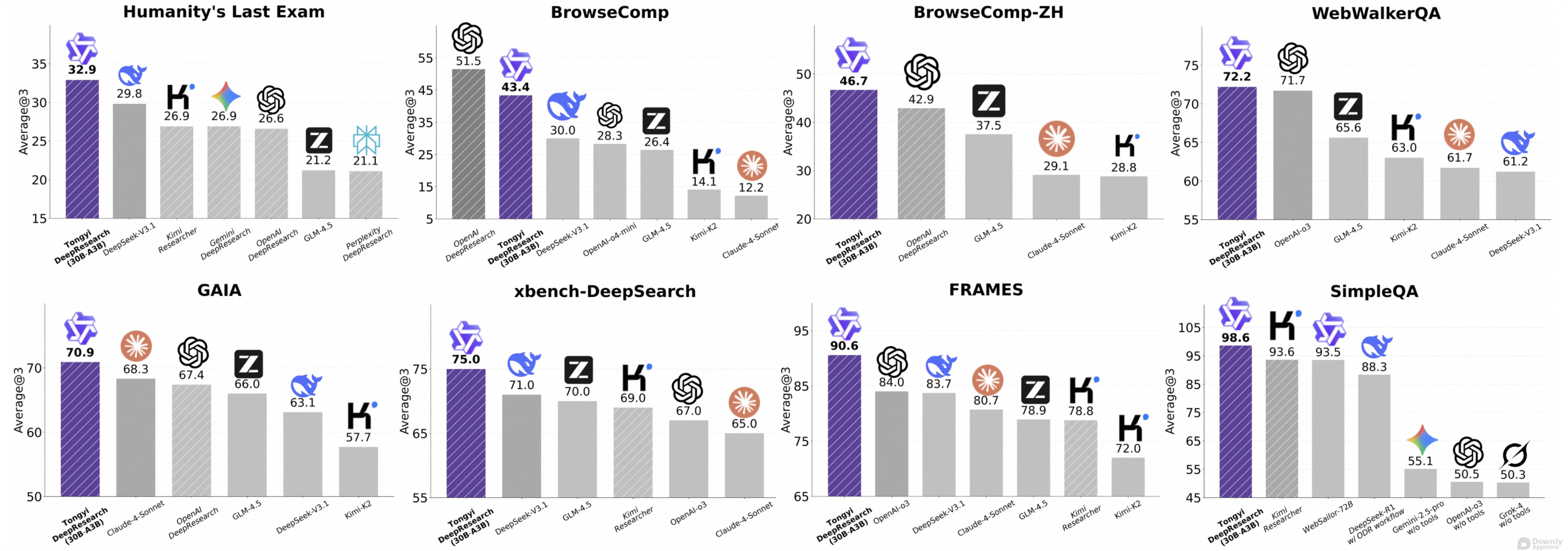

在Humanity’s Last Exam(HLE)、BrowseComp、GAIA等多个权威Agent评测基准上,通义DeepResearch的表现尤为出色。 该模型以仅3B的激活参数,其性能却超越了基于OpenAI o3、DeepSeek V3.1和Claude-4-Sonnet等旗舰级大模型的ReAct Agent(推理-行动智能体)。 这一成就使其成功登顶开源Agent模型排行榜,为深度研究Agent领域带来了“轻量化高性能”的全新可能性。

技术创新 破解行业难题

深度研究是近年来AI领域的研究热点,吸引了包括谷歌、OpenAI在内的众多科技巨头投入。 然而,现有的研发方法普遍采用“单窗口、线性累加”的信息处理模式,这使得Agent在处理长周期任务时,容易出现“认知空间窒息”和“不可逆的噪声污染”,从而导致推理能力下降,难以胜任复杂的研究任务。

为攻克这些难题,阿里通义团队构建了一套创新的训练与推理方案。

训练阶段

团队以Qwen3-30B-A3B模型为基础,构建了由合成数据驱动的完整训练链路,覆盖了预训练到后训练的全过程。 通过引入RL算法验证与真实训练模块,并结合异步强化学习算法和自动化数据策展流程,极大地提升了模型的迭代速度和泛化能力。

推理阶段

团队设计了两种模式:ReAct模式和基于自研IterResearch的Heavy模式。 其中,ReAct模式用于精准评估模型的基础能力,而Heavy模式则通过test-time scaling策略,深度挖掘模型性能上限,确保其在长周期任务中也能保持高质量的推理水平。

全面开源 赋能全球开发者

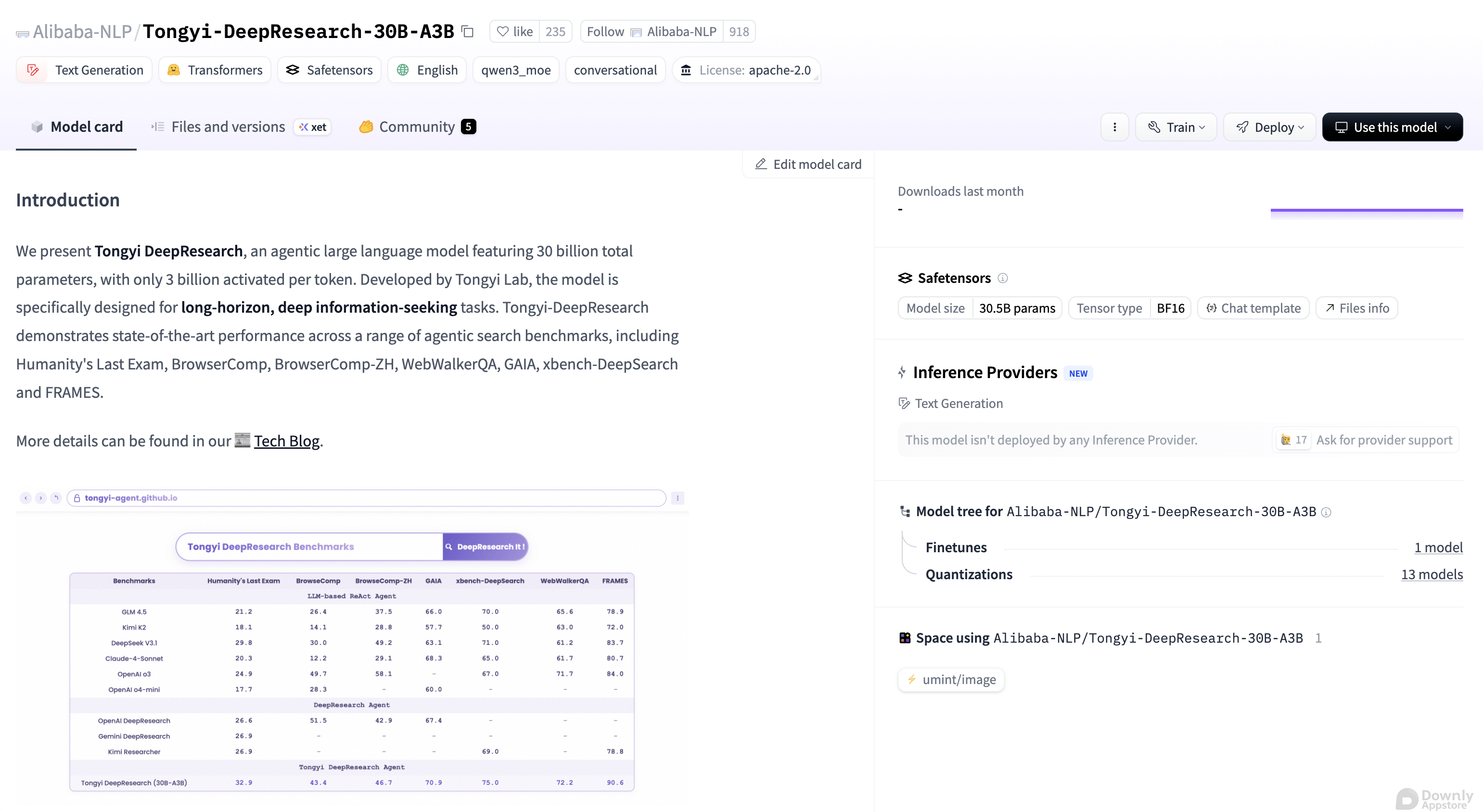

目前,通义DeepResearch的模型、代码和完整方案已经全面开源,并在Github、Hugging Face以及魔搭社区同步上线。 全球的开发者和研究人员均可免费下载和使用,这为攻克长周期、高复杂度的研究任务提供了强有力的工具支撑。

开源地址

- Github: https://github.com/Alibaba-NLP/DeepResearch

- Hugging Face: https://huggingface.co/Alibaba-NLP/Tongyi-DeepResearch-30B-A3B

- 魔搭社区: https://modelscope.cn/models/iic/Tongyi-DeepResearch-30B-A3B

这一举措不仅进一步完善了阿里在AI智能体领域的开源生态,也为全球AI社区的发展注入了新的活力。

相关推荐

2025 AI 技术峰会

AI 实战课程

热门工具

AI 助手

智能对话,提升效率

智能图像处理

一键美化,智能修图

AI 翻译

多语言实时翻译

评论 (0)

暂无评论,快来发表第一条评论吧!